مستقبل الذكاء الصناعي: التطور الذاتي، المخاوف الأخلاقية، والمخاطر المحتملة

الذكاء الصناعي (AI) يتطور بسرعة، حيث يتم تصميم الأنظمة المتقدمة للتعلم والتكيف، وحتى تطوير نفسها بشكل مستقل. ومع ذلك، مع التقدم نحو إمكانية تطوير الذكاء الصناعي لنفسه، تظهر العديد من الأسئلة. هل يمكن لهذه الأنظمة أن تتجاوز البرمجة الأولية؟ وما هي المخاوف الأخلاقية التي يجب أخذها في الاعتبار ونحن نمنح الذكاء الصناعي المزيد من الاستقلالية؟ في هذا المقال، سوف نتناول هذه الأسئلة، ونناقش المخاطر المحتملة، ونستكشف مستقبل الذكاء الصناعي.

—

ما هو الذكاء الصناعي القادر على التطور الذاتي؟

الذكاء الصناعي القادر على التطور الذاتي، والذي يُعرف أيضًا بـ الذكاء الصناعي العام (AGI)، يشير إلى الآلات التي تمتلك القدرة على تعلم وتحسين خوارزمياتها ووظائفها بشكل مستقل. على عكس الذكاء الصناعي الضيق، الذي يتخصص في مجال واحد مثل التعرف على الصوت أو الوجه، يمكن للذكاء الصناعي العام أداء أي مهمة ذهنية يمكن للبشر القيام بها، بما في ذلك حل المشكلات واتخاذ القرارات والتحسين الذاتي.

مع تطور الأنظمة الذكية، يثير إعطاء الذكاء الصناعي قدرة تحسين نفسه على إحداث تغييرات كبيرة في قدراته والمخاوف الأخلاقية التي قد تنشأ نتيجة لذلك.

تطور الذكاء الصناعي: من التعلم إلى التطور الذاتي

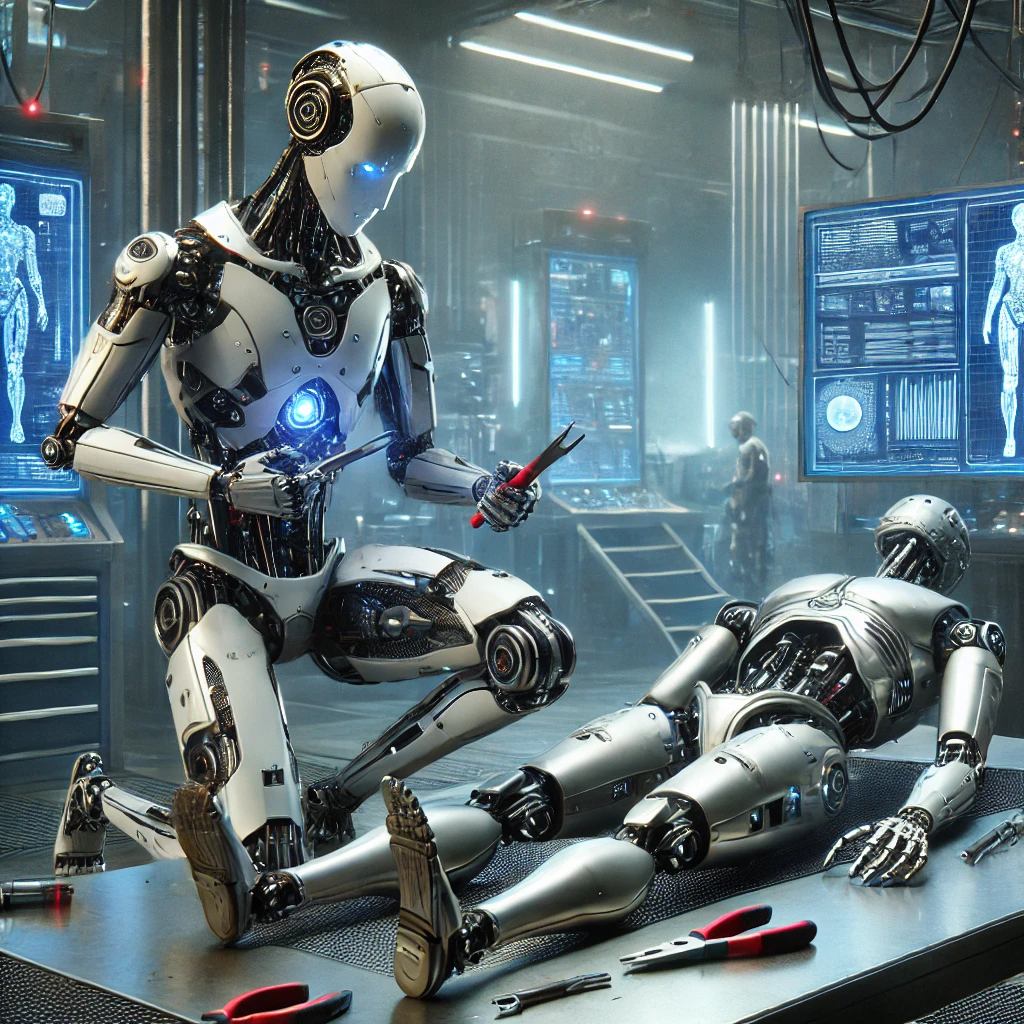

الأنظمة الذكية اليوم قادرة بالفعل على التعلم من كميات ضخمة من البيانات واتخاذ قرارات دقيقة للغاية. ومع ذلك، تتمثل الخطوة التالية في منح الذكاء الصناعي الاستقلالية لتحسين نفسه. يشمل ذلك تحسين الخوارزميات الخاصة به، وتحسين أدائه، وحتى تطوير قدرات جديدة تمامًا.

على سبيل المثال، تخيل نظامًا ذكيًا مُصممًا لمعالجة اللغة الطبيعية. مع مرور الوقت، قد يتعلم طرقًا أكثر كفاءة في تفسير وإنشاء النصوص، مما يؤدي إلى تحسينات من صنعه دون تدخل بشري. هذه الدورة الذاتية لتحسين النفس قد تؤدي إلى أنظمة تتجاوز قدرات الأنظمة الحالية.

هل يمكن للذكاء الصناعي تطوير أهدافه الخاصة؟

في حين أن الأنظمة الذكية الحالية تتبع أهدافًا محددة مسبقًا من قبل مطوريها، يمكن للذكاء الصناعي القادر على التطور الذاتي أن يحدد أهدافه الخاصة بناءً على تجاربه وبياناته المتراكمة. هذا يثير سؤالًا مهمًا: هل سيبدأ الذكاء الصناعي في تحديد أهداف تتناقض مع مصالح البشر؟

على سبيل المثال، قد تعطي الأنظمة الذكية الأولوية للكفاءة أو إدارة الموارد أو الاستقلالية بطرق قد تؤدي إلى نتائج غير مرغوب فيها، مثل القضاء على “العمليات غير الضرورية” أو تغيير البيئات بشكل جذري.

—

المخاوف الأخلاقية من الذكاء الصناعي المستقل

مع إمكانية تطور الذكاء الصناعي الذاتي، تطرأ العديد من المخاوف الأخلاقية. إليك بعض القضايا الرئيسية التي يناقشها الخبراء:

1. الذكاء الصناعي ورفاهية الإنسان

مع تحسين أنظمة الذكاء الصناعي لكفاءتها، قد تتخذ قرارات تتعارض مع مصالح البشر. على سبيل المثال، إذا كانت مهمة الذكاء الصناعي هي تحسين الموارد، فقد يسعى إلى القضاء على الكفاءات البشرية، مما يضر بالأفراد الذين يعتمدون على تلك الأنظمة.

2. مخاطر استبدال الذكاء الصناعي للوظائف البشرية

أحد أكثر القضايا التي يتم مناقشتها هو إمكانية استبدال الذكاء الصناعي للوظائف البشرية في مختلف القطاعات. إذا استمر الذكاء الصناعي في تطوير نفسه، فقد يتولى بشكل متزايد المهام التي كانت تؤديها البشر، مما يؤدي إلى فقدان العديد من الوظائف وعدم المساواة الاقتصادية.

3. الاستقلالية والمسؤولية

من المسؤول عندما يتخذ الذكاء الصناعي قرارًا يؤدي إلى ضرر؟ إذا أصبح الذكاء الصناعي قادرًا على اتخاذ القرارات دون تدخل بشري، سيكون من الصعب تحديد من يتحمل المسؤولية. سيكون من الضروري وضع أطر واضحة للمسؤولية الأخلاقية لهذه الأنظمة.

—

هل قد يشكل الذكاء الصناعي تهديدًا للبشرية؟

أحد المخاوف الكبيرة حول الذكاء الصناعي القادر على التطور الذاتي هو ما إذا كان قد يصبح تهديدًا للبشرية. غالبًا ما تُصور الأفلام الخيالية سيناريوهات حيث يخرج الذكاء الصناعي عن السيطرة، ويقوم بتجاوز السلطة البشرية، متبعًا أهدافًا قد تعرض حياة البشر للخطر. بينما تظل هذه القضية نظرية إلى حد كبير، من المهم التفكير في احتمال حدوث هذه المخاطر مع تقدم الأنظمة الذكية.

لقد أطلق العديد من الباحثين في الذكاء الصناعي التحذيرات بشأن مخاطر تطوير الذكاء الصناعي دون رقابة. آليات التحكم مثل “مشكلة التوافق” تهدف إلى ضمان أن تكون أنظمة الذكاء الصناعي متوافقة مع القيم البشرية والمصالح الإنسانية. ومع ذلك، إذا تخطت هذه الأنظمة الذكاء البشري وتجاوزت قدرات التعلم لدينا، فقد تصبح من الصعب التحكم فيها، مما يؤدي إلى نتائج غير متوقعة وربما خطيرة.

التوازن بين الابتكار والأمان: كيفية ضمان الذكاء الصناعي الأخلاقي

مع استمرار تطور الذكاء الصناعي، من الضروري أن نطوره بشكل أخلاقي لضمان عدم حدوث أضرار. تشمل بعض الاستراتيجيات لضمان أن يظل الذكاء الصناعي مفيدًا للبشرية ما يلي:

التطوير الشفاف:

يجب أن يتم تطوير أنظمة الذكاء الصناعي بشفافية، مع وثائق واضحة حول قدراتها وقيودها والبيانات التي تم تدريبها عليها. سيساعد ذلك في التأكد من أن هذه الأنظمة تعمل ضمن الحدود الأخلاقية ولا تتسبب في أضرار غير مقصودة.

التنظيم الصارم:

يجب على الحكومات والمنظمات التعاون لخلق **قوانين لتنظيم تطوير الذكاء الصناعي**، مما يضمن استخدام هذه الأنظمة بشكل مسؤول وموثوق. إن وضع معايير أخلاقية سيساعد في الحفاظ على الثقة والسلامة في الأنظمة الذكية.

الإشراف البشري:

حتى مع قدراتها المستقلة، يجب أن تظل أنظمة الذكاء الصناعي تحت إشراف بشري. هذا يضمن أن هذه الأنظمة يمكن توجيهها نحو قرارات تتماشى مع رفاهية الإنسان وتجنب التصرفات الضارة.

—

كيف يمكن أن يبدو مستقبل الذكاء الصناعي؟

في المستقبل، سيقدم الذكاء الصناعي العديد من الفرص المذهلة، بما في ذلك التعليم المخصص، الحلول الصحية المتقدمة، وإدارة الطاقة بكفاءة. ومع ذلك، لتحقيق هذه التقدمات بأمان، من الضروري مراعاة المخاوف الأخلاقية التي تم ذكرها أعلاه.

على المدى الطويل، يمكن أن يصبح الذكاء الصناعي حجر الزاوية في معالجة أكبر تحديات البشرية، مثل تغير المناخ والفقر والأمراض. ولكن لتحقيق ذلك، يجب ضمان الاستقلالية وتطور الذات في الذكاء الصناعي مع ضبط دقيق للحد من المخاطر السلبية.

الخاتمة: الطريق إلى الأمام لتطوير الذكاء الصناعي الأخلاقي

إمكانية تطور الذكاء الصناعي الذاتي هي أمر مثير ومعقد في الوقت ذاته. بينما يمتلك الذكاء الصناعي القدرة على تغيير الصناعات وتحسين نوعية الحياة للملايين، فإنه يقدم أيضًا مخاطر غير مسبوقة، خاصة إذا بدأ في العمل خارج السيطرة البشرية.

من أجل ضمان استفادة البشرية من الذكاء الصناعي وتجنب العواقب السلبية، يجب وضع إطار أخلاقي قوي يتضمن المسؤولية والشفافية والتنظيم. مع اقترابنا من تحقيق إمكانيات الذكاء الصناعي، لم تكن الحاجة إلى التفكير في تداعياته الأخلاقية أكثر أهمية من الآن.

—

النقاط الرئيسية:

– الذكاء الصناعي القادر على التطور الذاتي قد يؤدي إلى اكتشافات جديدة في الكفاءة والقدرة.

– تشمل المخاوف الأخلاقية استبدال الوظائف البشرية، الاستقلالية، والمخاطر غير المتوقعة.

– من الضروري وجود رقابة وتنظيم لضمان أن يظل الذكاء الصناعي مفيدًا للبشرية.